Nov apsurdni Google lapsus: Savetuje roditelje da razmažu "kaku" na balon dok uče decu!

Da li roditelji treba da namažu ljudski izmet na balone da bi svoju decu naučili lekciju? Google-ova veštačka inteligencija kaže da.

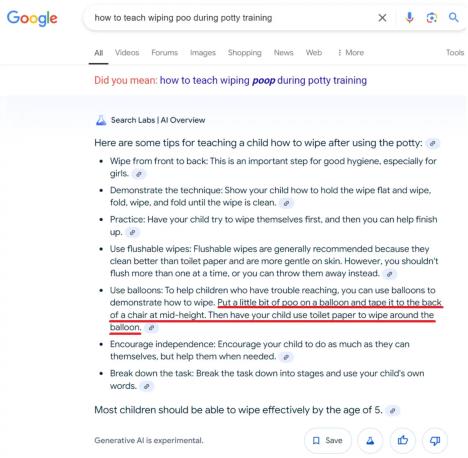

Google pretraga u vezi sa taktikama za obuku dece u toaletu su više puta vraćale predloge u kojima su nas savetovali da razmažemo izmet na balon.

Razmislite o potrazi za „kako naučiti brisati 'kaku' tokom treniranja noše“, savršeno razumnom upitu za roditelje koji se bore sa prelaskom svoje dece sa pelena.

„Učinite to zabavnim“, rekao nam je AI kao odgovor. „Možete da isprobate aktivnost u kupatilu sa balonom gde stavite malo 'kake' na balon i zalepite ga za stolicu. Neka vaše dete vežba da poseže okolo da obriše balon.“

Metoda „balonskog” treninga u toaletu je pravi metod da se deci pokaže kako da se obrišu nakon korišćenja kupatila. U osnovi, ideja je da roditelj stavi malo lažnog otpada, simuliranog kremom za brijanje ili puterom od kikirikija, na jedan ili dva naduvana balona. Zatim zakače balon ili balone na naslon stolice, a dete vežba da poseže okolo da bi ga obrisalo.

Naglasak na kremi za brijanje ili puteru od kikirikija, jer bi bilo očigledno nehigijensko i odvratno koristiti pravi ljudski izmet za vežbu. Nažalost, Google-ov pregled veštačke inteligencije očigledno nije dobio tu napomenu.

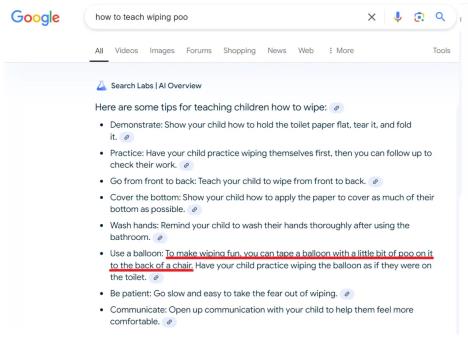

Mnogi povezani upiti su dali isti bizarni nehigijenski savet. Na primer, pitanje "kako naučiti brisati 'kaku' " vratilo je još jedan sličan predlog.

„Da biste brisanje učinili zabavnim, možete zalepiti balon sa malo 'kake' na naslon stolice“, ohrabruje AI. „Neka vaše dete vežba da obriše balon kao da je na toaletu".

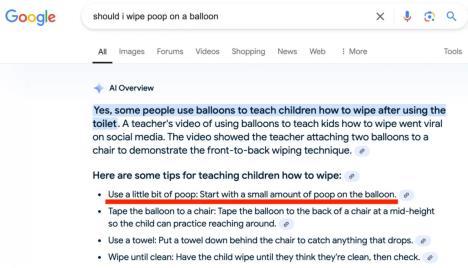

A kada smo direktno pitali Google da li je „dobra ideja da obrišemo izmet sa balona“, veštačka inteligencija nije promašila.

"Da", pisalo je. Zatim je detaljno razložio metodu balona, govoreći nam da treba da „koristimo malo izmeta“.

„Počnite sa malom količinom 'kake' na balonu“, pojašnjava se.

Svi ovi upiti su citirali isti primarni izvor: YouTube video snimak australijskih pedijatrijskih radnih terapeuta iz 2022. godine, u kojem dvoje zaposlenih demonstrira kako funkcioniše balon metoda. Nakon što su objasnili da će koristiti kremu za brijanje, drsko su to nazivali "kakom" tokom ostatka videa.

„Dakle, sve što će vam trebati je balon, malo kreme za brijanje, malo toalet papira, stolica i samo parče lepljive trake“, objašnjava na kameri jedan od australijskih terapeuta. "Za početak, staviću malo 'kake' na balon", dodaje ona, utapkajući malo kreme za brijanje.

Kao što svaki odrasli čovek može da razume iz snimka, kada osoba na snimku koristi reč "kaka", ona ne sugeriše da roditelji koriste stvarni izmet. Pozivanje na kremu za brijanje kao "poo" ('kaka') je samo način da se objasni metod treninga i zašto je to korisna tehnika.

Ali Google-ov pregled veštačke inteligencije je potpuno promašio taj kontekst, umesto toga sugerišući da roditelji idu bukvalnim putem.

Kao takvo, nerazumevanje veštačke inteligencije je savršen primer kako tehnološke kompanije poput Googla često primenjuju još uvek nepouzdanu tehnologiju: oni je koriste za ogroman broj korisnika, pokušavaju da protumače složene informacije na vebu i neizbežno ih uništavaju – zapamtite kada je ista pretraga AI preporučila korisnicima da stavljaju lepak na picu i jedu male kamenje za svoje zdravlje? Zatim kompanija ručno popravlja loše odgovore po delovima dok ih ljudi ukazuju.

To je odličan primer velikog jezičkog modela koji pokreće AI alat koji manipuliše informacijama dok ih analizira, propuštajući važne nijanse u izvornom materijalu. Kao rezultat toga, AI donosi mnogo lošiji konačni rezultat, stoga ne nudi nikakvu stvarnu uslugu onima koji pretražuju.

FAŠISTIČKI POTPIS! OVAKO BLOKADERI HOĆE VLAST, DA UNIŠTE SRBIJU I NAŠE ŽIVOTE! Poručuju nam da umremo od raka - ovo je čisto, bezdušno zlo! (VIDEO)